DeepSeek发布DeepEP:MoE模型训练推理新利器

AI导读:

DeepSeek发布了首个用于MoE模型训练和推理的开源EP通信库DeepEP,该技术能提升模型并行处理能力和训练效率,为AI领域注入新动力。

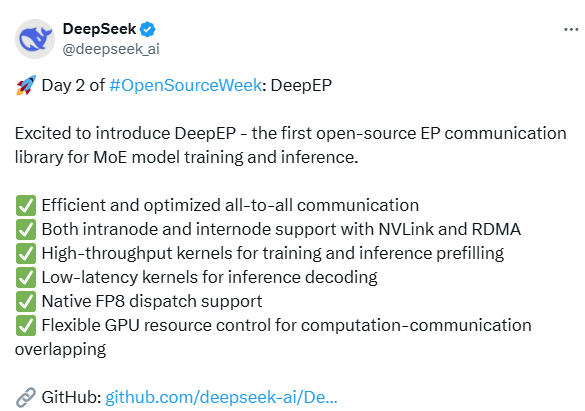

新京报贝壳财经讯(记者罗亦丹)北京时间2月25日,Deepseek发布了其“开源周”第二天的重磅成果:DeepEP,这是业界首个专为MoE模型(混合专家模型)训练和推理打造的开源EP通信库。

据悉,EP即Expert Parallelism(专家并行),是大规模分布式AI模型训练中不可或缺的技术,能显著提升模型的并行处理能力和训练效率,为AI领域的发展注入新动力。

DeepSeek方面介绍,DeepEP具备多项突出特点:其高效且优化的全对全(all-to-all)通信机制,节点内和节点间完美支持NVLink和RDMA技术;训练和推理预填充的高吞吐量内核,推理解码的低延迟内核,原生FP8调度支持,以及灵活的GPU资源控制,这些特性共同实现了计算与通信的完美重叠,进一步提升了AI模型的训练与推理效率。

DeepSeek发布的公告截图,展示了DeepEP的卓越性能。

(文章来源:新京报)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。