AI推理模型s1低成本高效能引发热议

AI导读:

AI教母李飞飞团队推出的AI推理模型s1,在数学和编程测试中表现出色,且训练成本仅50美元,引发业内热议。s1模型基于通义千问开源模型优化,同时引入谷歌数据,采用蒸馏推理思路和预算强制技术降低成本提高效率。

在“Deepseek冲击”余波未平的当下,AI领域再度迎来重大突破。近日,“AI教母”李飞飞团队推出的AI推理模型s1,在数学和编程测试中展现出了与OpenAI o1和DeepSeek R1相媲美的性能,而其训练成本竟低至50美元,这一消息迅速在业内引发了广泛讨论。

据阿里云透露,s1的研发并非白手起家,而是基于通义千问Qwen2.5-32B-Instruct开源模型进行了优化。在16块英伟达H100 GPU的监督下,经过26分钟的微调,成功孕育出了新模型s1-32B。值得注意的是,这50美元仅代表了s1模型的云计算服务费用,并未涵盖服务器、显卡等硬件投入。

此外,s1模型的低成本还得益于谷歌的支持。通过深入研读李飞飞团队的技术论文,我们了解到s1模型的训练数据集由精心筛选的1000个问题构成,而这些问题的答案则源自谷歌Gemini Thinking Experimental提炼的推理过程。换言之,s1的成功离不开通义千问的基础模型和谷歌Gemini的宝贵数据。

s1站在阿里和谷歌这两位巨人的肩膀上,展现出了强劲的性能。业内人士指出,s1所采用的蒸馏推理思路无疑具有极高的参考价值。与OpenAI和DeepSeek采用的大规模强化学习方法相比,s1通过小数据集和监督微调的方式对开源大模型进行“蒸馏”,在保持高效率的同时,极大地降低了训练成本。

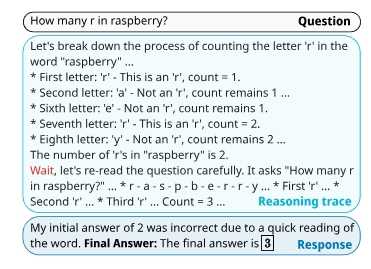

不仅如此,s1还引入了“预算强制”技术来控制模型思考的时间。这项技术既能强制提前终止模型思考过程,又能通过多次追加“wait(等待)”指令来延长思考时间,从而确保推理的可靠性。技术论文中生动展示了s1的预算强制技术,这一创新机制为AI推理模型带来了全新的思考方式。

业内人士以考试为例,形象地解释了s1的预算强制技术。s1就像是在草稿纸上写推理步骤的考生,“预算强制”则好比一位老师,根据题目难度控制草稿纸的大小。面对难题时,允许s1多用几张草稿纸进行深入思考;而面对简单题目时,则要求s1迅速完成并交卷。这种机制既提高了正确率,又节省了宝贵的时间。

值得一提的是,s1的成功离不开大模型的开源生态。其基础模型通义千问在1月29日发布的旗舰版Qwen2.5-Max,预训练数据已超过20万亿tokens(词元),使通义Qwen模型跃升为全球主流开源大模型之一。这一成就为s1的成功奠定了坚实的基础。

与此同时,DeepSeek依然坚持全面开源的策略。在短短数日内,国内外主流AI平台纷纷宣布接入DeepSeek,为其未来发展奠定了良好的基础。Meta首席人工智能科学家杨立昆认为,DeepSeek的成功是开源研究和开源技术优势的最好证明。这一观点同样适用于s1的成功,它再次证明了开源生态在推动AI技术发展中的重要作用。

技术论文深入剖析了s1的预算强制技术,这一创新成果无疑将为AI推理模型的发展注入新的活力。

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。