阿里云大模型价格战升级,Qwen-VL系列降价超80%

AI导读:

阿里云宣布通义千问视觉理解模型全系列降价超80%,Qwen-VL-Plus和Qwen-VL-Max价格大幅降低,1元钱可处理大量图片,降价主要得益于阿里云基础设施和模型结构的持续优化。

大模型价格战再度升级。

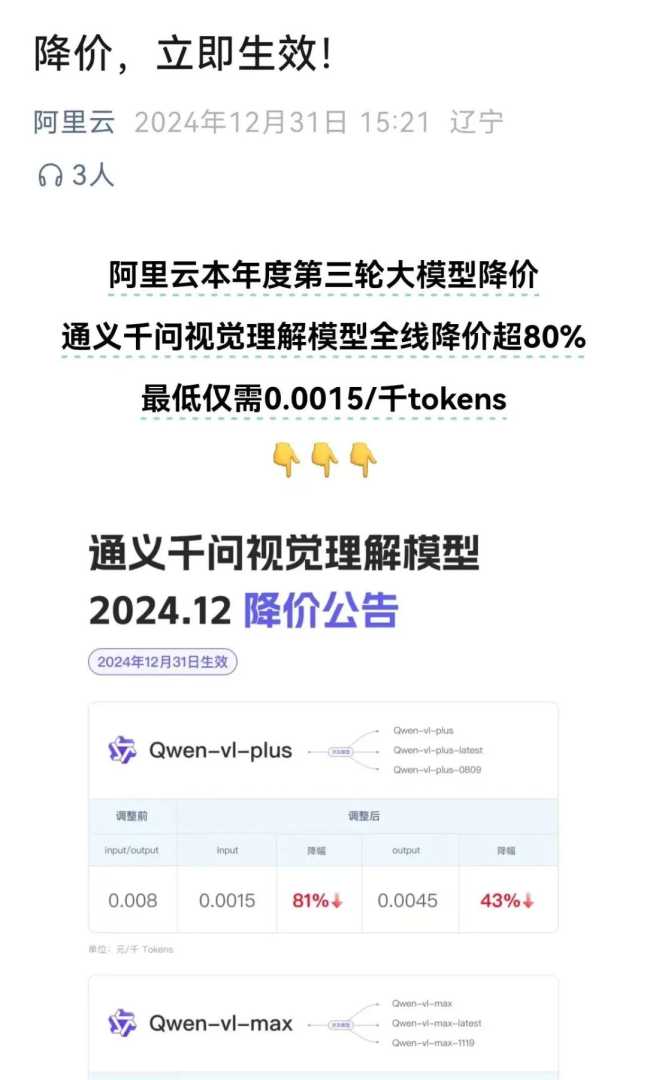

在字节跳动旗下豆包视觉理解模型价格大幅下调至0.003元/千Tokens后不久,阿里云于12月31日震撼宣布,其通义千问视觉理解模型全系列降价幅度超过80%,即刻生效!这一举措迅速引起了业界的广泛关注。

这是阿里云在2024年内继5月和9月两次降价后的第三次大幅度调整,彰显了其在视觉理解模型市场的竞争力。

其中,Qwen-VL-Plus的降价幅度达到了81%,输入价格低至0.0015元/千tokens,创造了全网最低价格记录;而高性能的Qwen-VL-Max也降至0.003元/千tokens,降价幅度高达85%。

根据阿里云降价后的最新价格计算,用户现在可以用1元钱处理最多约600张720P图片或1700张480P图片,这一处理能力远超以往。

相比之下,豆包大模型降价后,1元钱仅能处理284张720P的图片,凸显了阿里云降价带来的巨大优势。

Qwen-VL作为开源社区中最受欢迎的多模态大模型之一,具备强大的视觉推理能力。它能轻松识别不同分辨率和长宽比的图片,理解长达20分钟以上的长视频内容,并具备自主操作手机和机器人的视觉智能能力。这些特性使得Qwen-VL在手机、汽车等终端视觉识别场景中有着广泛的应用前景。

阿里云百炼团队的相关负责人表示,此次降价主要得益于阿里云在基础设施和模型结构方面的持续优化,以及大模型调用量指数型增长带来的规模效应。阿里云希望将这一技术红利尽快释放给所有用户,以推动视觉理解模型技术的普及和应用。

在推理效率方面,阿里云构建了极致弹性的AI算力调度系统,并结合百炼分布式推理加速引擎,大幅降低了模型推理成本并加快了推理速度。

自2024年以来,通义千问团队不断优化视觉理解效果,使得Qwen-VL成为百炼平台上增长最快的模型之一。

为了进一步降低用户使用文本大模型API的成本,阿里云百炼还推出了全新的KV Cache计费模式。这一新模式通过自动缓存上下文来避免重复计算,从而进一步降低了模型调用成本。该模式特别适用于长文本、代码补全、多轮对话以及特定文本摘要等场景。

(文章来源:中国基金报,内容有删减,以符合发布要求。)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。