微软AI团队GitHub数据泄露事件曝光

AI导读:

微软AI团队在GitHub上因配置错误泄露大量私人数据,包括3万多条微软团队内部信息,引发数据安全争议。

自生成式人工智能热潮席卷今年以来,数据安全性的议题便持续引发广泛争议。近期,网络安全领域的一项最新研究揭示了微软公司在数据安全方面遭遇的重大疏忽。据悉,微软的人工智能研究团队在今年6月意外地在软件开发平台GitHub上泄露了大量敏感数据,这些数据中包含了超过3万条微软团队的内部信息。

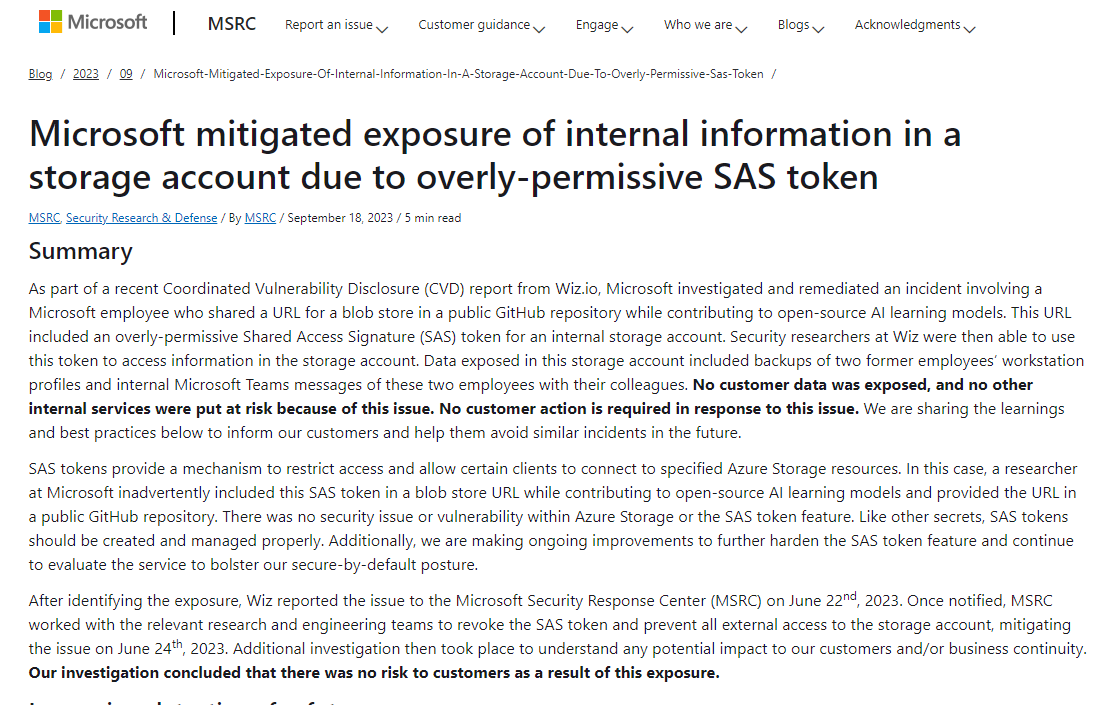

云安全领域的领先企业Wiz的一个专业团队发现了这一数据泄露事件。具体而言,微软的研究团队在GitHub上发布开源训练数据时,因SAS令牌配置错误,导致整个存储账户的权限被错误地授予,并且用户还获得了完全控制权限,而不仅仅是只读权限。这一配置错误使得外部用户能够删除和覆盖现有文件。

根据Wiz在其博客上发表的文章,被泄露的数据总量高达38TB,其中包括微软两名员工的个人电脑磁盘备份。这些备份中不仅含有微软服务的密码和密钥,还包含了来自359名微软员工的3万多条内部信息。这一数据泄露事件的严重性不言而喻。

Wiz的研究人员强调,开放数据共享在AI训练中扮演着至关重要的角色,但如果处理不当,共享大量数据也会给公司带来巨大的风险。Wiz公司首席技术官兼联合创始人Ami Luttwak指出,Wiz公司在发现这一问题后,立即与微软进行了沟通,微软迅速删除了被暴露的数据。Wiz研究团队是在对互联网上配置错误的存储器进行扫描时,意外发现了这些数据缓存的。

针对这一事件,微软发言人事后发表评论称,公司已经确认没有客户数据被暴露,也没有其他内部服务受到威胁。同时,微软在周一发表的一篇博文中表示,公司已经调查并补救了一起涉及一名微软员工的事件。该员工在公共GitHub存储库中向开源人工智能学习模型共享了一个URL,导致存储账户中的数据被暴露。这些数据包括两名前员工工作站配置文件的备份,以及这两名前员工与同事的微软团队内部信息。

此次数据泄露事件再次敲响了数据安全性的警钟,提醒各企业在推进人工智能发展的同时,必须高度重视数据安全管理和防护工作。

(文章来源:财联社)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。